编者按:小样本图像分类是小样本学习研究领域中的一个热点问题,对其展开应用和研究,有十分重大的现实意义。基于度量学习的方法在该领域中得到了广泛应用,并且取得了显著效果。但是在应用这种方法时,由于观测噪声的存在,所以网络模型对于不同输入对应的特征表达具有不同的置信度。对不确定度的建模和利用,对于提升优化效率十分重要。

因此,微软亚洲研究院的研究员们提出了不确定性感知小样本图像分类方法。相关研究论文“Uncertainty-Aware Few-Shot Image Classification”已被国际人工智能联合会议 IJCAI 2021 收录。欢迎感兴趣的读者点击阅读原文,查看论文全文。

小样本学习可以降低机器学习算法的数据依赖性,对于实际应用意义重大。其中,小样本图像分类旨在从少量标注样本中学习识别新的类别。在该领域中,基于度量学习的方法得到了广泛研究并取得了显著效果。具体而言,这种方法是按照特征空间相似度将待分类样本与支持集合中最近邻的类中心进行匹配,进而实现分类的。但是,由于观测噪声的存在,网络模型对于不同输入对应的特征表达具有不同的置信度。对不确定度的建模和利用,对于提升小样本学习的优化效率十分重要,但这在以前却经常被忽略。

因此,微软亚洲研究院的研究员们提出了不确定性感知小样本图像分类方法。该方法将“样本-类中心”对的相似度从原来的确定性表征转变为概率化表征,并且将相似度的不确定性在该概率化表征中进行参数化。同时该方法还利用图模型,联合预测每个样本与支撑集中所有的类中心相似度的不确定性,以实现不确定性感知优化。最后,研究员们还基于强基线模型对该方法进行了性能验证。相对于该强基线模型,本文提出方法的性能得到了显著提升,并超过 SOTA 方法。相关研究论文“Uncertainty-Aware Few-Shot Image Classification”已被国际人工智能联合会议 IJCAI 2021 收录。

论文链接:https://arxiv.org/pdf/2010.04525.pdf

方法简介

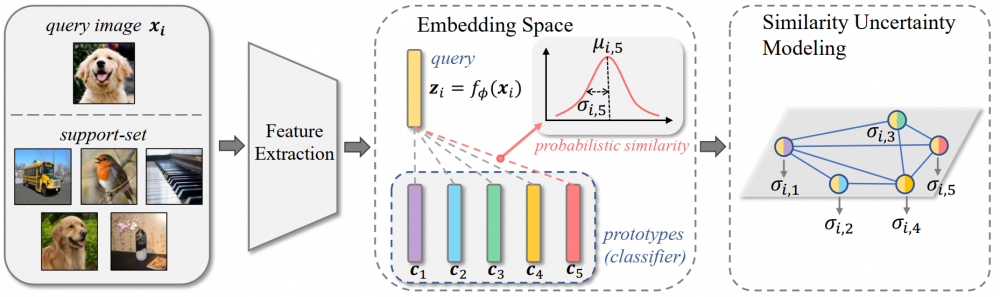

在基于度量学习的小样本图像分类中,“样本-类中心”对的相似度由样本和类中心在特征空间中的表征共同决定。因此与之前的工作不同,本文的方法不再对特征表征的不确定性建模,而是对特征相似度的不确定性进行建模。(如图1)

图1:不确定性感知图像分类的流程图

不确定度建模:研究员们首先对待分类样本(query)和支持集(support)中的样本进行特征提取,将每个样本用一个特征向量表示。同时对支撑集中每个类别的不同样本的特征向量进行平均,进而得到类中心。然后,研究员们将每个样本和类中心之间的相似度建模成一个由均值 μ 和方差 σ 参数化的高斯分布。其中,均值 μ 表示根据确定性方式计算得到的相似度度量,并以此代表最有可能的相似度度量值;方差 σ 则表示该相似度的不确定程度。

不确定度估计:考虑到基于相似度的图像分类,是将待分类样本与所有的类中心进行相似度计算,从而对应于一个“联合决策”过程。因此,研究员们提出:基于全局上下文信息,利用图模型联合估计所有“样本-类中心”对的相似度不确定性。对于一个给定的待分类样本,可将其对应的所有“样本-类中心”对作为图模型中的节点,进而利用图模型进行全局范围内的信息传递。该图模型对应节点的输出即为对应于“样本-类中心”对相似度的不确定性估计结果。

基于图模型的不确定性预测器具有两个优点:(1)对参与分类任务的类别数有可伸缩性,使得可以在网络训练的不同阶段对不确定性预测器进行训练;(2)可以利用全局上下文信息进行不确定性预测。

不确定性感知优化:通过上述对于相似度不确定性的建模,研究员们将相似度从确定性表征转变成概率化表征。此时,分类的 logits 将从一个概率分布变成一个联合概率分布,其每一维由一个高斯分布建模。由于该联合概率分布的期望的解析解难以得到,所以研究员们采用了 Monte Carlo 积分,对该联合分布期望进行近似估计,从而实现不确定性感知优化。

实验结果

基线模型:本文工作基于一个强基线模型进行性能验证。该强基线模型的训练分两个阶段进行:

(1)全局分类训练阶段。对训练集中的所有类别,通过一个由全连接层构建的分类器,利用交叉熵损失函数,对特征提取器和分类器进行模型训练。

(2)回合制训练阶段。在该阶段,每次随机采样 N 个类别,每个类别随机采样 K 个样本,从而组成一个“N-way,K-shot”的支撑集,进而计算待分类样本与支撑集合中所有类中心在特征空间的相似度。最后,利用交叉熵损失函数进行基于相似度的分类训练。

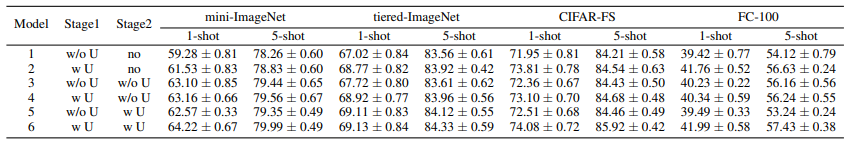

性能验证实验:首先验证不确定性建模对于不同训练阶段优化的有效性,实验结果如表1所示。其中“w/o U”表示不使用不确定性感知优化;“w U”表示使用本文提出的不确定性感知优化;“no”表示不进行对应阶段的训练。

表1:相似度不确定性建模对于不同训练阶段的有效性分析

由表1可知,在不同阶段中使用本文提出的不确定感知优化方法,对于小样本图像分类任务的准确率均有明显提升。除此以外,在第一个阶段中对不确定性预测器进行预训练,可以使模型取得更优的实验结果。这得益于图模型构建的不确定性预测器,从而使其对于参与分类任务的类别数具有可伸缩性。

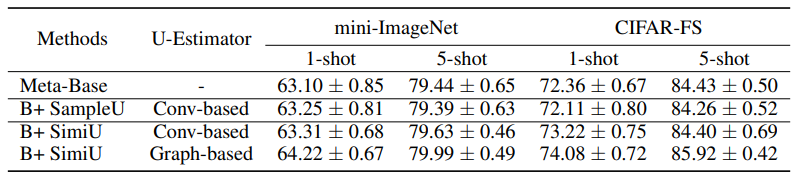

不同建模方式的对照实验:在该实验中,研究员们将对相似度及样本的特征表达进行不确定性建模和实验对比。同时,研究员们还对比了不确定性预测器不同的结构设计,实验结果如表2所示。其中,“SampleU”表示对样本表征进行不确定性建模;“SimiU”表示对“样本-类中心”对相似度进行不确定性建模。“Conv-based”表示基于卷积模型的不确定性预测器;“Graph-based”表示基于图模型的不确定性预测器。实验结果表明,本文提出的相似度不确定性建模方法和基于图模型的不确定性预测器具有较好的实验性能。

表2:不同不确定性的建模和预测方式对比实验

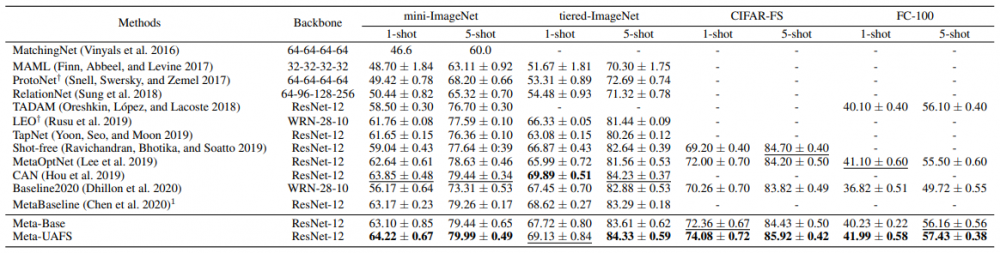

与 SOTA 方法的性能对比:研究员们在 mini-ImageNet、tiered-ImageNet、CIFAR-FS 和 FC-100 四个通用小样本图像分类数据集上,将所提出的不确定性感知小样本图像分类模型与 SOTA 方法进行性能对比,实验结果如表3所示。实验证明了本文提出的方法在大多数情况下均能超过已有 SOTA 方法。

表3:与 SOTA 方法的性能对比。其中“l1-l2-l3-l4”表示由四层卷积神经网络构成的 Backbone 模型,各层的卷积核数目分别为 l1,l2,l3 和 l4。

结论

在本文中,研究员们提出了不确定性感知小样本图像分类方法。利用数据独立的不确定性建模,来降低观测噪声对于小样本学习的不良影响。研究员们首先将“样本-类中心”对的相似度从确定性建模方式转变为概率化建模方式;然后设计了一个基于图模型的不确定性预测器,利用全局范围的上下文信息对“样本-类中心”对的相似度不确定性进行联合预测,从而实现不确定性感知优化。与此同时,通过实验对比,还验证了本文提出方法的有效性,并证明了该方法能够在多个通用公开数据集上取得 SOTA 的实验性能。

本文作者:张直政

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。