编者按:一直以来,图片描述生成任务都是人工智能领域研究人员们关注的热点话题。近期学术界提出的 Localized-Narratives 数据集,为图片描述生成的可控性和可解释性研究提供了新的机会。基于此,微软亚洲研究院的研究员们展开了深入研究,致力于对图像描述生成任务中所涉及的语义概念进行空间和时序关系上的控制,以提高其表现性能。同时,研究员们还提出了一种新模型 LoopCAG,并通过一系列实验证明了其在多个层面的可控性优势。

针对视觉信号和语言信号的对应关系这一研究热点,研究员们从图片描述生成的可控性角度给出了解答,但想要深度理解和研究这一问题还有很长的路要走。希望感兴趣的读者可以阅读论文全文,并发表自己的独特观点,和研究员们一起交流学术感想!

图片描述生成是一项非常经典的人工智能任务,但是随着人们对其关注度的提高,如何控制生成的内容还需要进一步探究。为了生成用户希望且具备事实依据的图片描述,学术界近期提出了一个被称为 Localized-Narratives 的数据集,并且将鼠标轨迹作为一个额外的输入,引入到图片描述生成任务中。

对此,微软亚洲研究院的研究员们进行了深入研究,发现鼠标轨迹的引入可以增强图片描述生成的可控性和可解释性,同时研究员们还提出了一种新模型 LoopCAG,显著提升了图片描述生成的性能。相关论文“Control Image Captioning Spatially and Temporally”已被 ACL 2021 接收。(论文链接:https://aclanthology.org/2021.acl-long.157.pdf)

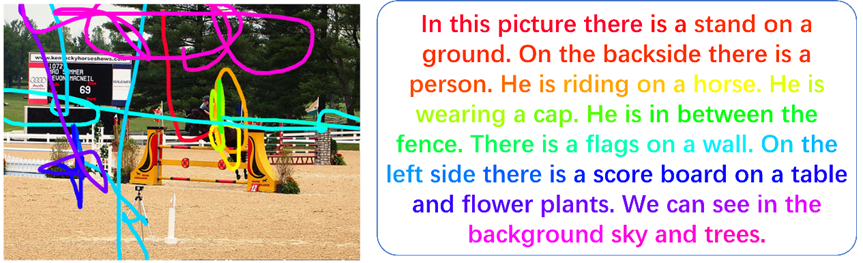

轨迹控制的图片描述生成任务可以定义为:当给定一个图像和代表用户意图的鼠标轨迹时,模型应该生成与轨迹的每个部分相对应的描述。例如,当在图1左侧的图像上画上彩色轨迹时,需要生成如图1右侧的描述。轨迹和标有相同颜色的描述是相互对应的。从图1中可以看出,描述中的一些词,例如 “person”、“horse”、“tree”,可以在空间上直接与图片中的视觉对象一一对应。同时,生成描述的顺序需要与轨迹的顺序保持一致。

图1:轨迹控制的图片描述生成

虽然,人们可以很容易地做到按轨迹的指示顺序来描述图片中的视觉对象 。但对于人工智能系统来说,如何识别、强调并沿着这些坐标安排视觉语义,是一件非常困难且具有研究意义的事情。

在这项工作中,微软亚洲研究院的研究员们主要致力于对图像描述生成任务中所涉及的语义概念进行控制,其包含两个层面:空间上的对应关系和时序上的排列次序。空间上的对应关系是指,描述中的每一个词都应该在图像的正确区域找到正确的对应;时序上的排列次序是指,描述和轨迹之间的语义顺序应该保持一致。

轨迹控制图片描述生成任务的形式化表述

研究员们首先给出了针对这个问题的形式化表述。对于视觉输入,需要在图像上应用一个预先训练好的视觉目标检测器,得到一个对象级别的视觉特征集 V={v_1,…,v_N} ,其中包括 N 个视觉对象的向量表示。相对应的文字描述则是生成目标,表示为一个字符序列 Y={y_1,…,y_l},其中 y_j 是第 j 个字符,l 是字符序列的长度。

原始轨迹输入是一个带有时间戳的轨迹点序列,将轨迹点序列按相同的时间窗口

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。